Con l'ascesa dei modelli linguistici di grandi dimensioni (LLM) e la proliferazione dei casi d'uso dell'IA, stanno emergendo nuovi standard per facilitare l'accesso alle informazioni sui siti web. Tra questi standard c'è il file llms.txt, un equivalente AI-first ispirato a robots.txt e sitemap.xml, ma specificamente progettato per aiutare gli LLM (Large Language Models) e i loro strumenti (ad esempio ChatGPT, Claude, Cursor, Windsurf, Replit Ghostwriter, ecc.) a comprendere e utilizzare meglio i tuoi contenuti.

In questa mega guida, scoprirai:

- Le origini di

llms.txt - I suoi benefici per il SEO e l'accessibilità delle informazioni

- Come implementarlo sul tuo sito

- Best practice e trappole da evitare

- Esempi concreti

- Risorse e strumenti esistenti per facilitare il tuo lavoro

1. Cos'è llms.txt e perché usarlo?

Il file llms.txt è un file di testo scritto in Markdown (anche se mantiene l'estensione .txt) posizionato alla radice di un sito web, come robots.txt. Il suo scopo è guidare le IA direttamente durante la fase di inferenza (quando un utente o un agente conversazionale cerca informazioni precise in tempo reale) fornendo:

- Una panoramica chiara e semplificata del tuo sito.

- Indicazioni strutturate su come il contenuto dovrebbe essere compreso, estratto o utilizzato.

- Link potenziali a risorse critiche (documentazione, pagine API, FAQ, guide tecniche, ecc.) in forma Markdown.

- Informazioni opzionali per arricchire il contesto (quando la finestra di contesto di un LLM è limitata nel numero di token, puoi definire un blocco di risorse secondarie che possono essere ignorate se necessario).

In altre parole, llms.txt diventa un catalizzatore che indirizza le IA verso i contenuti essenziali e impedisce loro di analizzare in modo approssimativo, o troppo voluminoso, le pagine HTML tradizionali piene di elementi di design, animazioni e pubblicità.

1.1 Contesto e necessità

- Gli LLM sono spesso limitati dalla loro finestra di contesto e non possono caricare o elaborare un intero sito di grandi dimensioni.

- L'HTML può essere complesso da analizzare (barra di navigazione, menu a tendina, script JS).

- Le IA non hanno necessariamente la stessa logica di "crawl" dei motori di ricerca (GoogleBot, BingBot), e alcuni IDE o agenti conversazionali (Cursor, Claude Code, ecc.) richiedono una versione "testo semplice" o "Markdown" della documentazione.

Pertanto, llms.txt ottimizza il modo in cui le IA ottengono una panoramica del sito, consentendo un migliore utilizzo durante la fase di inferenza (ad es. suggerimenti di codice, risposte esperte, Plugin ChatGPT, ecc.).

2. Qual è la differenza tra llms.txt, robots.txt e sitemap.xml?

robots.txt: Dice ai bot (es. GoogleBot, BingBot) dove possono o non possono eseguire il crawling. Non fornisce contenuto, solo regole di accesso.sitemap.xml: Elenca tutte le pagine indicizzabili per i motori di ricerca (URL, data ultimo aggiornamento, priorità). È molto utile per il SEO, ma non fornisce una descrizione del contenuto né menziona la forma "AI-friendly" delle pagine.llms.txt: Un file Markdown indirizzato alle IA per descrivere o puntare a pagine usate durante l'inferenza. Può anche includere estratti strategici, link esterni fondamentali e persino versioni .md delle tue pagine. È uno strumento opt-in progettato per servire gli agenti direttamente. Può complementare, non sostituire, robots.txt o sitemap.xml.

3. Struttura e formato raccomandati

Il file llms.txt mira ad essere semplice e flessibile. Ecco la struttura proposta:

3.1 Punti chiave:

- H1: Il titolo principale, il nome del sito o progetto, unico e obbligatorio.

- Blockquote: Breve descrizione del sito (poche righe).

- Corpo del file: Paragrafo/i aggiuntivi per chiarire il ruolo del sito o dare indicazioni su come interpretare certi elementi del contenuto.

- Sezioni delimitate da H2:

- Elenco, usando il formato lista Markdown, di link a risorse rilevanti.

- Menzione opzionale di link esterni critici (es. se la tua documentazione è distribuita tra GitHub, GitLab o altri siti).

- Puoi avere più sezioni, come "API", "Tutorial", "Esempi", ecc.

- Sezione "Opzionale": Ti permette di indicare alle IA che questa sezione ha priorità inferiore. Se l'IA esaurisce lo spazio, può ignorare questo contenuto.

Nota: Gli URL possono terminare con .md se vuoi fornire direttamente la versione testo/Markdown delle tue pagine.

4. Esempi concreti

4.1 FastHTML

Nella documentazione FastHTML, c'è un llms.txt (file demo) che punta a:

- Una guida rapida

- Un riferimento HTMX

- Esempi avanzati

- Risorse opzionali su Starlette

4.2 Anthropic, Perplexity, ElevenLabs, Cloudflare

- Anthropic: offre un

llms-full.txt con tutta la documentazione. Questo facilita l'uso in IDE o chatbot (es. Cursor) che caricano questo file direttamente. - Cloudflare: sta considerando di fornire un

llms.txt dedicato per descrivere i suoi servizi. - LangChain, LangGraph: forniscono già

llms.txt e llms-full.txt per consentire il caricamento della documentazione in un agente conversazionale.

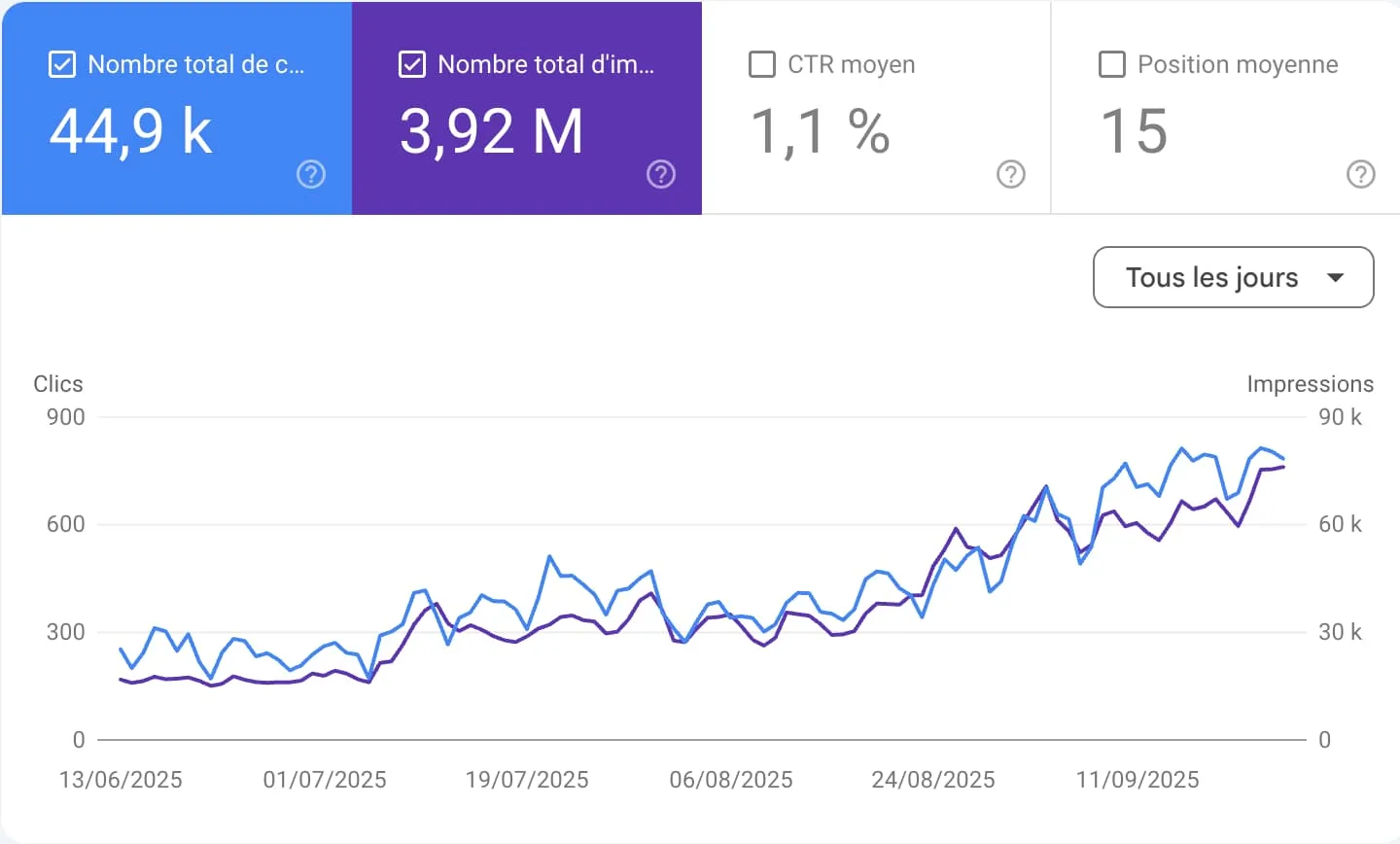

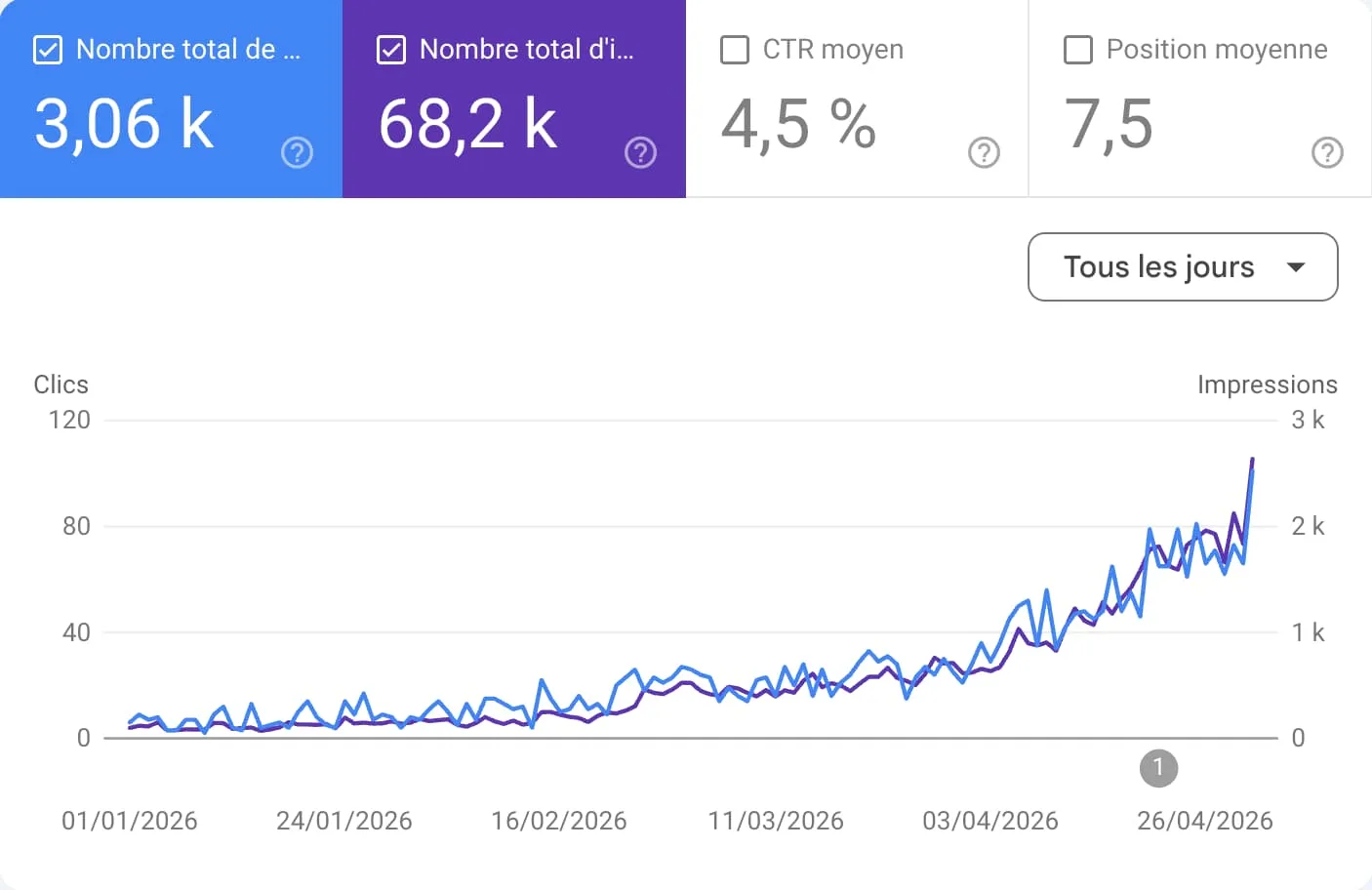

5. Benefici per il tuo SEO e la strategia di contenuto

Anche se llms.txt non è diretto ai motori di ricerca tradizionali, migliora indirettamente il SEO:

- Migliore visibilità negli ambienti IA. Quando qualcuno interroga uno strumento simile a ChatGPT o un tool IA connesso, il tuo contenuto ha più probabilità di essere correttamente identificato e citato.

- Riduzione del rumore: Fornisci il contesto essenziale, che può ridurre confusione o disinformazione.

- Migliore esperienza utente: In IDE e assistenti di codice, i suggerimenti sulla tua libreria/strumento saranno più accurati, aumentando la soddisfazione degli utenti e favorendo un passaparola positivo.

- Autorità del brand: Mostra che il tuo sito è "AI-Ready" e usa standard moderni (un segnale di marketing e fiducia).

6. Come generare e mantenere il tuo llms.txt?

6.1 Metodo manuale

- Elenca le tue pagine prioritarie (guida all'installazione, documentazione API, FAQ prodotto).

- Aggiungi un riassunto conciso per link (

: breve panoramica). - Struttura con intestazioni

##, sezioni "opzionali", ecc.

6.2 Strumenti e plugin

Diversi progetti open-source e servizi SaaS offrono di generare il tuo llms.txt automaticamente:

- llmstxt Generator di Firecrawl o dotenvx: Esegue il crawl della tua sitemap, estrae le informazioni chiave e crea uno scheletro

llms.txt. - Plugin WordPress (es. "Website LLMs.txt"): scansionano i tuoi post/pagine e generano un file strutturato.

- Servizi come Mintlify, LangGraph o llmstxthub.com che analizzano la tua documentazione e producono un

llms.txt. - Estensioni VSCode (

LLMs.txt Explorer): per caricare o creare llms.txt dall'editor.

6.3 Buone pratiche di aggiornamento

- Aggiorna dopo ogni modifica importante alla tua documentazione o quando aggiungi una nuova sezione importante.

- Controlla regolarmente i link esterni, poiché un link rotto in

llms.txt può fuorviare le IA. - Mantieni un formato minimalista (non serve includere tutta la documentazione, basta quanto necessario per guidare l'IA verso risorse più dettagliate).

7. Controversie e limitazioni

- Manipolazione dei contenuti: Alcuni temono che attori malevoli possano inserire informazioni fuorvianti in

llms.txt. Se gli LLM si affidano ciecamente al file, possono "allucinare" o propagare informazioni false. - Adozione: Perché lo standard funzioni, IDE/agenti devono rispettarlo. Alcuni progetti IA lo ignorano; altri lo supportano già.

- Non è uno standard ufficiale W3C: Alcuni esperti propongono di fornire un percorso

/.well-known/llms.txt per allinearsi con RFC 8615, mentre altri preferiscono usare example.com/llms.txt direttamente.

8. Conclusione: Dovresti adottare llms.txt per potenziare il tuo SEO IA?

llms.txt non è obbligatorio, ma sta guadagnando popolarità tra IDE intelligenti, plugin IA e comunità open-source. Semplifica l'integrazione dei contenuti in progetti IA in tempo reale, evita lo spreco di token e promuove una documentazione meglio compresa dai modelli linguistici.

Risorse aggiuntive

In breve

Il file llms.txt si distingue come un nuovo pilastro nel toolkit SEO e IA. Fornendo un digest gerarchico dei tuoi contenuti chiave, facilita la ricerca contestuale da parte degli agenti conversazionali e valorizza la tua documentazione tecnica. Man mano che chatbot e IDE intelligenti diventano il "nuovo gateway" alle informazioni, adottare llms.txt può fare la differenza.

Non aspettare per implementarlo! Approfitta oggi della sinergia tra il tuo SEO tradizionale e questo nuovo livello IA per offrire la migliore esperienza possibile agli utenti… umani e intelligenze artificiali.

.svg)

.svg)