Con el auge de los grandes modelos de lenguaje (LLM) y la proliferación de casos de uso de la IA, están surgiendo nuevos estándares para facilitar el acceso a la información en los sitios web. Entre ellos se encuentra el archivo llms.txt, un equivalente AI-first inspirado en robots.txt y sitemap.xml, pero diseñado específicamente para ayudar a los LLM (Large Language Models) y sus herramientas (por ejemplo, ChatGPT, Claude, Cursor, Windsurf, Replit Ghostwriter, etc.) a comprender y utilizar mejor tu contenido.

En esta mega guía, descubrirás:

- Los orígenes de

llms.txt - Sus ventajas para el SEO y la accesibilidad de la información

- Cómo implementarlo en tu propio sitio

- Buenas prácticas y errores a evitar

- Ejemplos concretos

- Recursos y herramientas existentes para facilitarte el trabajo

1. ¿Qué es llms.txt y por qué usarlo?

El archivo llms.txt es un archivo de texto escrito en Markdown (aunque conserva la extensión .txt) ubicado en la raíz de un sitio web, como robots.txt. Su objetivo es guiar a las IAs directamente durante la fase de inferencia (cuando un usuario o agente conversacional busca información precisa en tiempo real) proporcionando:

- Una visión clara y simplificada de tu sitio.

- Indicaciones estructuradas sobre cómo debe entenderse, extraerse o utilizarse el contenido.

- Enlaces potenciales a recursos críticos (documentación, páginas API, FAQs, guías técnicas, etc.) en formato Markdown.

- Opcional: información para enriquecer el contexto (cuando la ventana de contexto de un LLM está limitada en número de tokens, puedes definir un bloque de recursos secundarios que pueden ignorarse si es necesario).

En otras palabras, llms.txt se convierte en un catalizador que orienta a las IAs hacia el contenido esencial y les impide parsear de forma burda, o demasiado voluminosa, las páginas HTML tradicionales llenas de elementos de diseño, animaciones y publicidad.

1.1 Contexto y necesidad

- Los LLM están a menudo limitados por su ventana de contexto y no pueden cargar o procesar un sitio voluminoso en su totalidad.

- El HTML puede ser complejo de analizar (barra de navegación, menús desplegables, scripts JS).

- Las IAs no tienen necesariamente la misma lógica de «crawl» que los motores de búsqueda (GoogleBot, BingBot), y algunos IDEs o agentes conversacionales (Cursor, Claude Code, etc.) necesitan una versión plain text o Markdown de la documentación.

Así, llms.txt racionaliza la manera en que las IAs obtienen una visión general del sitio, permitiendo un mejor uso durante la fase de inferencia (sugerencias de código, respuestas expertas, plugins de ChatGPT, etc.).

2. ¿Cuál es la diferencia entre llms.txt, robots.txt y sitemap.xml?

robots.txt: Indica a los bots (GoogleBot, BingBot, etc.) dónde pueden o no rastrear. No proporciona contenido, solo reglas de acceso.sitemap.xml: Lista todas las páginas indexables para los motores de búsqueda (URL, fecha de última actualización, prioridades). Muy útil para el SEO, pero no proporciona una descripción del contenido ni menciona la forma «AI-friendly» de las páginas.llms.txt: Un archivo Markdown dirigido a las IAs para describir o apuntar a páginas utilizadas durante la inferencia. También puede incluir extractos estratégicos, enlaces externos fundamentales e incluso versiones .md de tus páginas. Es una herramienta opt-in diseñada para servir a los agentes directamente. Complementa, pero no reemplaza, robots.txt o sitemap.xml.

3. Estructura y formato recomendados

El archivo llms.txt pretende ser simple y flexible. Esta es la estructura propuesta:

3.1 Puntos clave:

- H1: El título principal, el nombre del sitio o proyecto, único y obligatorio.

- Blockquote: Breve descripción del sitio (pocas líneas).

- Cuerpo del archivo: Párrafo(s) adicional(es) para precisar el rol del sitio o dar indicaciones sobre cómo interpretar ciertos elementos de contenido.

- Secciones delimitadas por H2:

- Listar, en formato lista Markdown, los enlaces a recursos relevantes.

- Mencionar opcionalmente enlaces externos críticos (p.ej., si tus docs están repartidos en GitHub, GitLab u otros sitios).

- Puedes tener varias secciones, como «API», «Tutoriales», «Ejemplos», etc.

- Sección «Opcional»: Permite indicar a las IAs que esta sección tiene menor prioridad. Si la IA se queda sin espacio, puede ignorar este contenido.

Nota: Las URLs pueden terminar en .md si deseas proporcionar directamente la versión texto/Markdown de tus páginas.

4. Ejemplos concretos

4.1 FastHTML

En la documentación de FastHTML, existe un llms.txt (archivo de demostración) que apunta a:

- Un inicio rápido

- Una referencia HTMX

- Ejemplos avanzados

- Recursos opcionales sobre Starlette

4.2 Anthropic, Perplexity, ElevenLabs, Cloudflare

- Anthropic: ofrece un

llms-full.txt con toda su documentación. Esto facilita el uso en IDEs o chatbots (p.ej. Cursor) que cargan este archivo directamente. - Cloudflare: está considerando proporcionar un

llms.txt dedicado para describir sus servicios. - LangChain, LangGraph: ya proporcionan

llms.txt y llms-full.txt para permitir cargar la documentación en un agente conversacional.

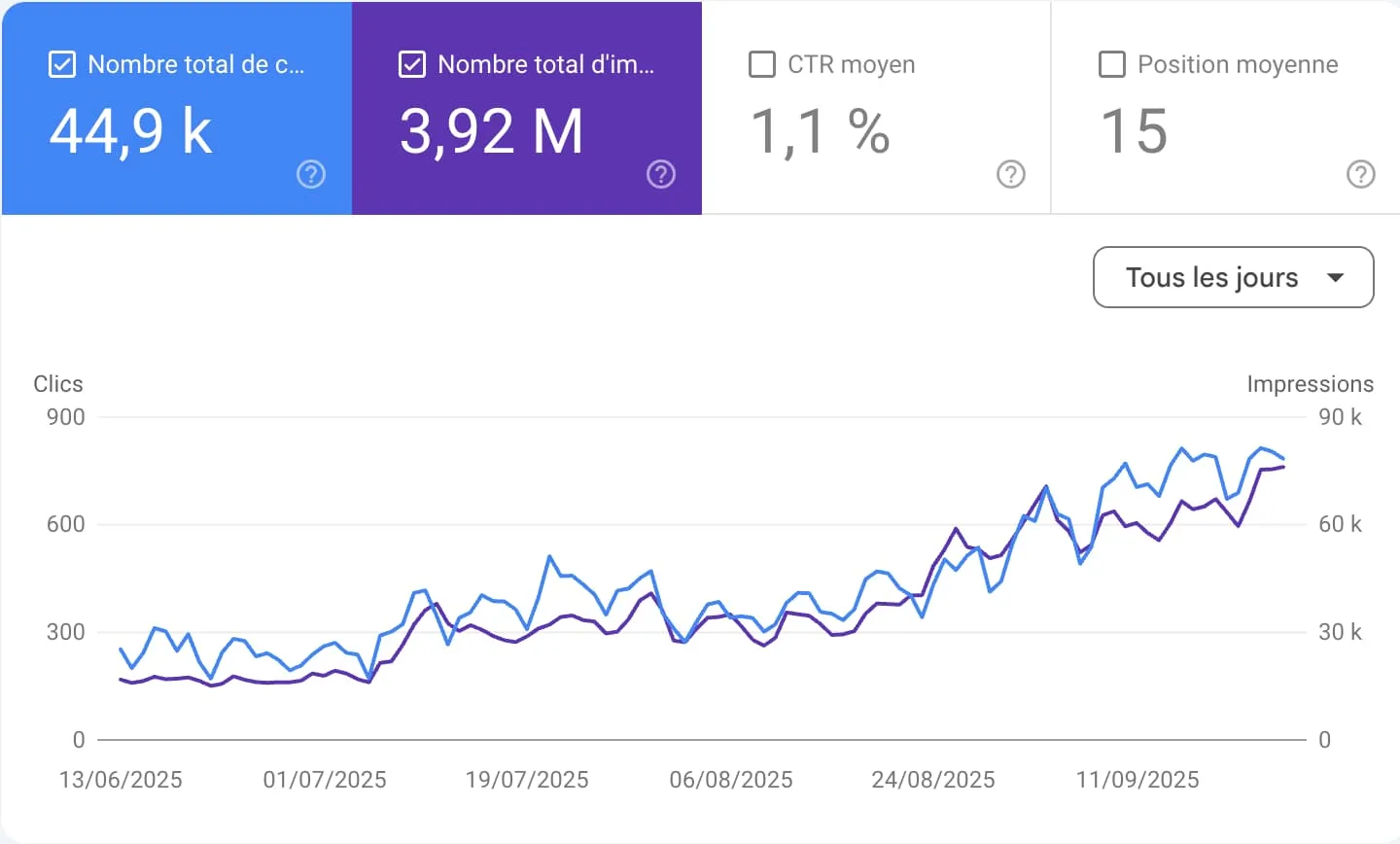

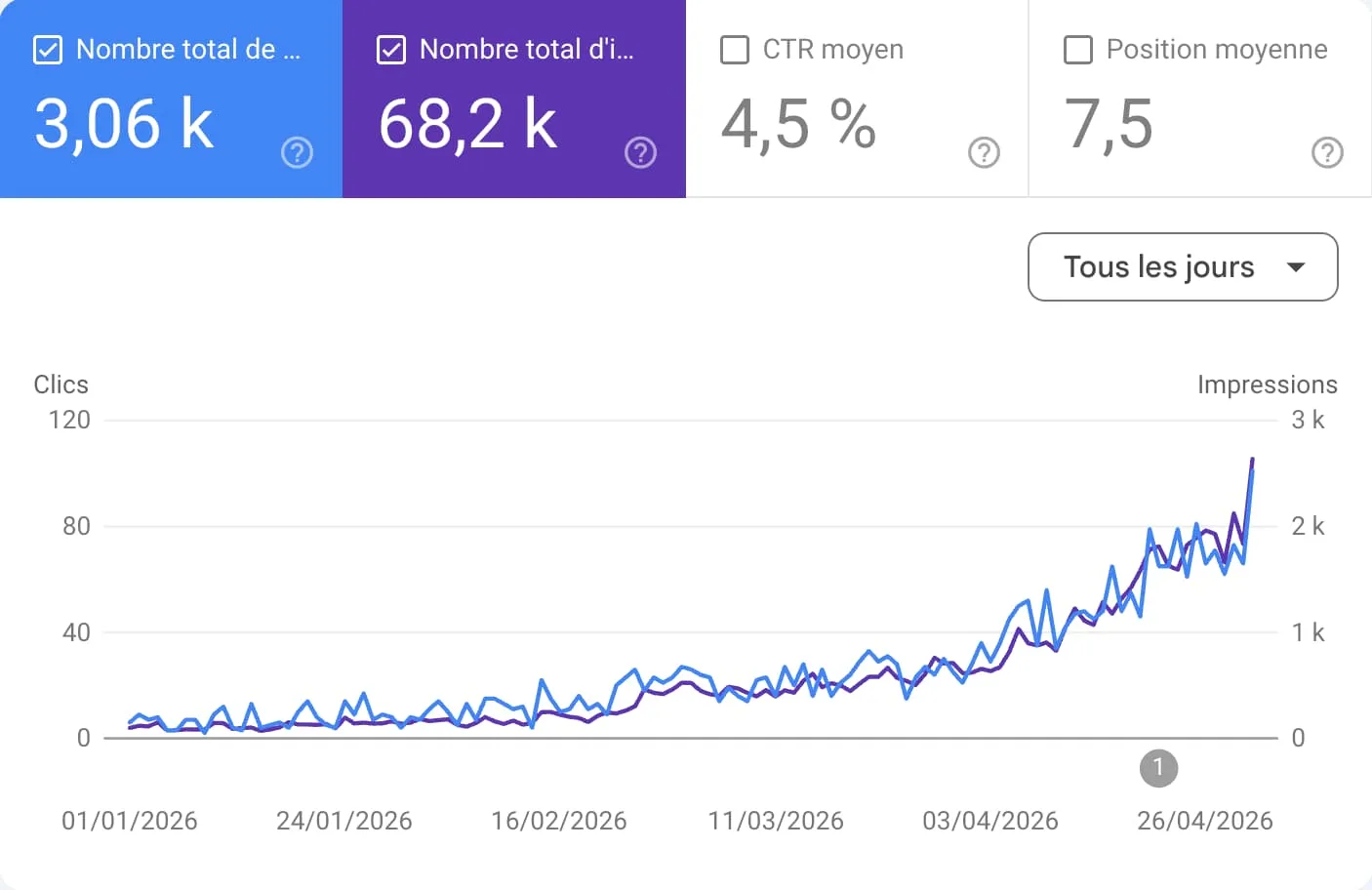

5. Ventajas para tu SEO y estrategia de contenido

Aunque llms.txt no está dirigido directamente a los motores de búsqueda tradicionales, mejora indirectamente el SEO:

- Mayor visibilidad en entornos de IA. Cuando alguien consulta una herramienta tipo ChatGPT o una IA conectada, tu contenido tiene más probabilidades de ser correctamente identificado y citado.

- Reducción del ruido: Proporcionas contexto esencial, lo que puede reducir confusiones o desinformación.

- Mejora de la experiencia del usuario: En IDEs y asistentes de código, las sugerencias sobre tu biblioteca/herramienta serán más precisas, aumentando la satisfacción del usuario y fomentando el boca a boca positivo.

- Autoridad de marca: Demuestra que tu sitio está «AI-Ready» y utiliza estándares modernos (una señal de marketing y confianza).

6. ¿Cómo generar y mantener tu llms.txt?

6.1 Método manual

- Lista tus páginas prioritarias (guía de instalación, docs API, FAQ del producto).

- Añade un resumen conciso por enlace (

: breve descripción). - Estructura con encabezados

##, secciones «opcional», etc.

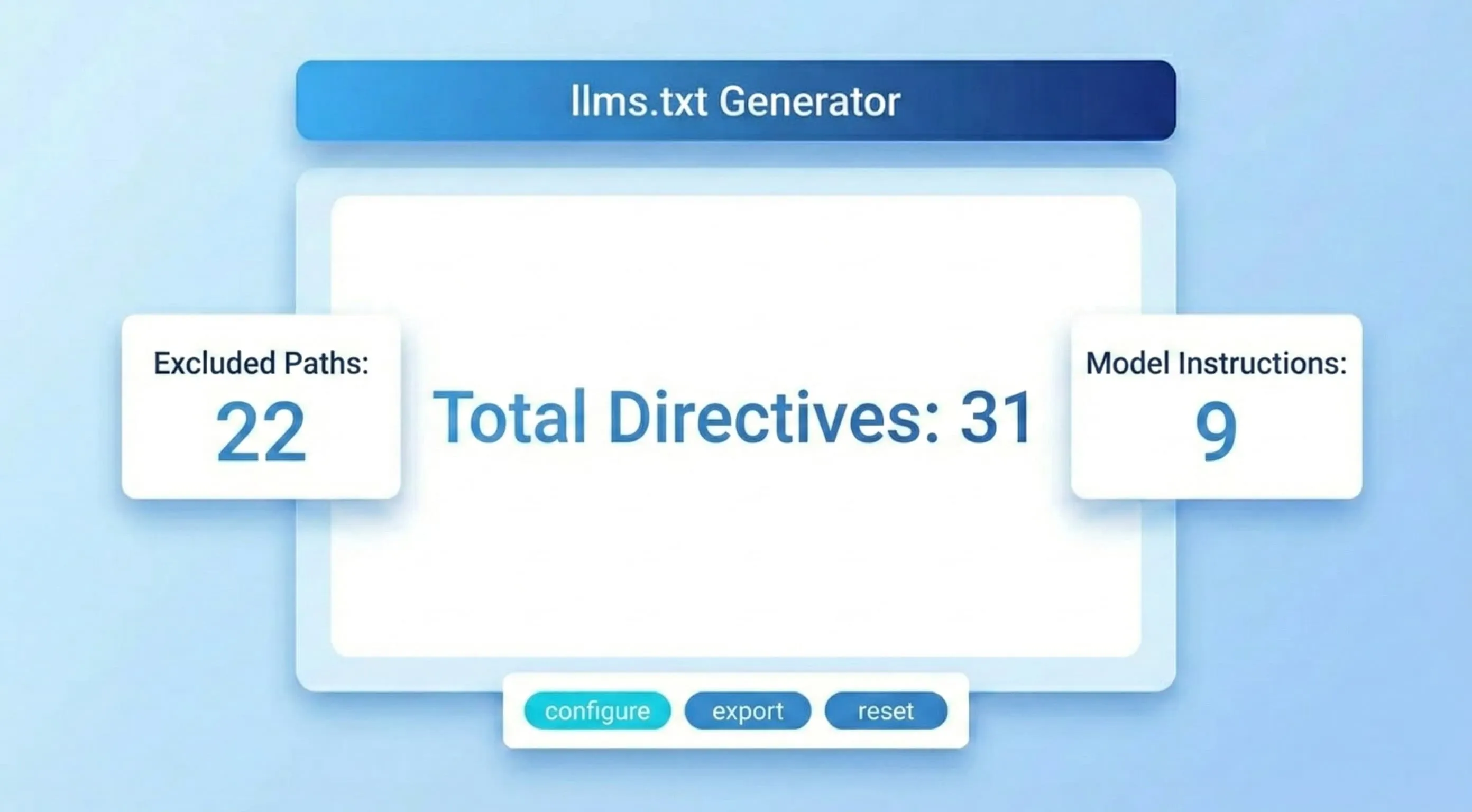

6.2 Herramientas y plugins

Varios proyectos open-source y servicios SaaS ofrecen generar tu llms.txt automáticamente:

- llmstxt Generator de Firecrawl o dotenvx: Rastrea tu sitemap, extrae información clave y crea un esqueleto de

llms.txt. - Plugins de WordPress (p.ej. «Website LLMs.txt»): Escanean tus posts/páginas y generan un archivo estructurado.

- Servicios como Mintlify, LangGraph o llmstxthub.com que analizan tus docs y producen un

llms.txt. - Extensiones de VSCode (

LLMs.txt Explorer): Para cargar o crear un llms.txt desde el editor.

6.3 Buenas prácticas de actualización

- Actualiza después de cada cambio importante en tus docs o al añadir una nueva sección relevante.

- Verifica regularmente los enlaces externos, ya que un enlace roto en

llms.txt puede inducir a error a las IAs. - Mantiene un formato minimalista (no es necesario incluir toda la documentación, solo lo suficiente para guiar a la IA hacia recursos más detallados).

7. Controversias y limitaciones

- Manipulación de contenido: Algunos temen que actores maliciosos inserten información engañosa en

llms.txt. Si los LLM confían ciegamente en el archivo, pueden «alucinar» o propagar información falsa. - Adopción: Para que el estándar funcione, los IDEs/agentes deben respetarlo. Algunos proyectos de IA lo ignoran; otros ya lo soportan.

- No es un estándar oficial del W3C: Algunos expertos abogan por proporcionar una ruta

/.well-known/llms.txt para alinearse con la RFC 8615, mientras que otros prefieren usar directamente example.com/llms.txt.

8. Conclusión: ¿Deberías adoptar llms.txt para impulsar tu SEO de IA?

llms.txt no es obligatorio, pero está ganando popularidad entre los IDEs inteligentes, plugins de IA y comunidades open-source. Simplifica la integración de contenido en proyectos de IA en tiempo real, evita el desperdicio de tokens y promueve una documentación mejor comprendida por los modelos de lenguaje.

Recursos adicionales

En resumen

El archivo llms.txt se posiciona como una nueva piedra angular en el kit de herramientas de SEO e IA. Al proporcionar un condensado jerárquico de tu contenido clave, facilita la búsqueda contextual por parte de los agentes conversacionales y destaca tu documentación técnica. A medida que los chatbots y los IDEs inteligentes se convierten en la «nueva puerta de entrada» a la información, adoptar llms.txt puede marcar la diferencia.

¡No esperes para implementarlo! Aprovecha hoy la sinergia entre tu SEO tradicional y esta nueva capa de IA para ofrecer la mejor experiencia posible a los usuarios… humanos e inteligencias artificiales.

.svg)

.svg)