Avec la montée en puissance des grands modèles de langage (LLM) et la multiplication des cas d’usage de l’IA, de nouveaux standards émergent pour faciliter l’accès à l’information sur les sites web. Parmi eux, le fichier llms.txt, un équivalent AI-first inspiré de robots.txt et sitemap.xml, mais conçu spécifiquement pour aider les LLM (Large Language Models) et leurs outils (par exemple ChatGPT, Claude, Cursor, Windsurf, Replit Ghostwriter, etc.) à mieux comprendre et utiliser votre contenu.

Dans ce méga guide, vous découvrirez :

- Les origines de

llms.txt - Ses avantages pour le SEO et l’accessibilité de l’information

- Comment l’implémenter sur votre propre site

- Les bonnes pratiques et les pièges à éviter

- Des exemples concrets

- Les ressources et outils existants pour vous faciliter la tâche

1. Qu’est-ce que llms.txt et pourquoi l’utiliser ?

Le fichier llms.txt est un fichier texte rédigé en Markdown (même s’il conserve l’extension .txt) placé à la racine d’un site web, comme robots.txt. Son objectif est de guider les IA directement pendant la phase d’inférence (lorsqu’un utilisateur ou un agent conversationnel cherche des informations précises en temps réel) en fournissant :

- Un aperçu clair et simplifié de votre site.

- Des indications structurées sur la manière dont le contenu doit être compris, extrait ou utilisé.

- Des liens potentiels vers des ressources critiques (documentation, pages API, FAQ, guides techniques, etc.) sous forme Markdown.

- Optionnel : des informations pour enrichir le contexte (lorsque la fenêtre de contexte d’un LLM est limitée en nombre de tokens, vous pouvez définir un bloc de ressources secondaires qui peuvent être ignorées si nécessaire).

Autrement dit, llms.txt devient un catalyseur qui oriente les IA vers le contenu essentiel et les empêche de parser grossièrement, ou de manière trop volumineuse, les pages HTML traditionnelles remplies d’éléments de design, d’animations et de publicités.

1.1 Contexte et besoin

- Les LLM sont souvent limités par leur fenêtre de contexte et ne peuvent pas charger ou traiter un site volumineux dans son intégralité.

- Le HTML peut être complexe à analyser (barre de navigation, menus déroulants, scripts JS).

- Les IA n’ont pas nécessairement la même logique de « crawl » que les moteurs de recherche (GoogleBot, BingBot), et certains IDE ou agents conversationnels (Cursor, Claude Code, etc.) nécessitent une version « plain text » ou « Markdown » de la documentation.

Ainsi, llms.txt rationalise la manière dont les IA obtiennent un aperçu du site, permettant une meilleure utilisation pendant la phase d’inférence (suggestions de code, réponses expertes, plugins ChatGPT, etc.).

2. Quelle différence entre llms.txt, robots.txt et sitemap.xml ?

robots.txt : indique aux bots (GoogleBot, BingBot, etc.) où ils peuvent ou non explorer. Il ne fournit pas de contenu, seulement des règles d’accès.sitemap.xml : liste toutes les pages indexables pour les moteurs de recherche (URL, date de dernière mise à jour, priorités). Très utile pour le SEO, mais il ne fournit pas de description du contenu ni ne mentionne la forme « AI-friendly » des pages.llms.txt : un fichier Markdown destiné aux IA pour décrire ou pointer vers des pages utilisées lors de l’inférence. Il peut également inclure des extraits stratégiques, des liens externes fondamentaux et même des versions .md de vos pages. C’est un outil opt-in conçu pour servir les agents directement. Il complète, mais ne remplace pas, robots.txt ou sitemap.xml.

3. Structure et format recommandés

Le fichier llms.txt se veut simple et flexible. Voici la structure proposée :

3.1 Points clés :

- H1 : le titre principal, le nom du site ou du projet, unique et obligatoire.

- Blockquote : brève description du site (quelques lignes).

- Corps du fichier : paragraphe(s) supplémentaire(s) pour préciser le rôle du site ou donner des indications sur la manière d’interpréter certains éléments de contenu.

- Sections délimitées par des H2 :

- Lister, au format liste Markdown, les liens vers les ressources pertinentes.

- Mentionner éventuellement des liens externes critiques (par ex., si vos docs sont répartis sur GitHub, GitLab ou d’autres sites).

- Vous pouvez avoir plusieurs sections, comme « API », « Tutoriels », « Exemples », etc.

- Section « Optionnel » : permet d’indiquer aux IA que cette section est de moindre priorité. Si l’IA manque d’espace, elle peut ignorer ce contenu.

Note : les URL peuvent se terminer par .md si vous souhaitez fournir directement la version texte/Markdown de vos pages.

4. Exemples concrets

4.1 FastHTML

Dans la documentation FastHTML, on trouve un llms.txt (fichier de démonstration) qui pointe vers :

- Un démarrage rapide

- Une référence HTMX

- Des exemples avancés

- Des ressources optionnelles sur Starlette

4.2 Anthropic, Perplexity, ElevenLabs, Cloudflare

- Anthropic : propose un

llms-full.txt avec l’intégralité de sa documentation. Cela facilite l’utilisation dans les IDE ou chatbots (par ex. Cursor) qui chargent ce fichier directement. - Cloudflare : envisage de fournir un

llms.txt dédié pour décrire ses services. - LangChain, LangGraph : fournissent déjà des

llms.txt et llms-full.txt pour permettre le chargement de la documentation dans un agent conversationnel.

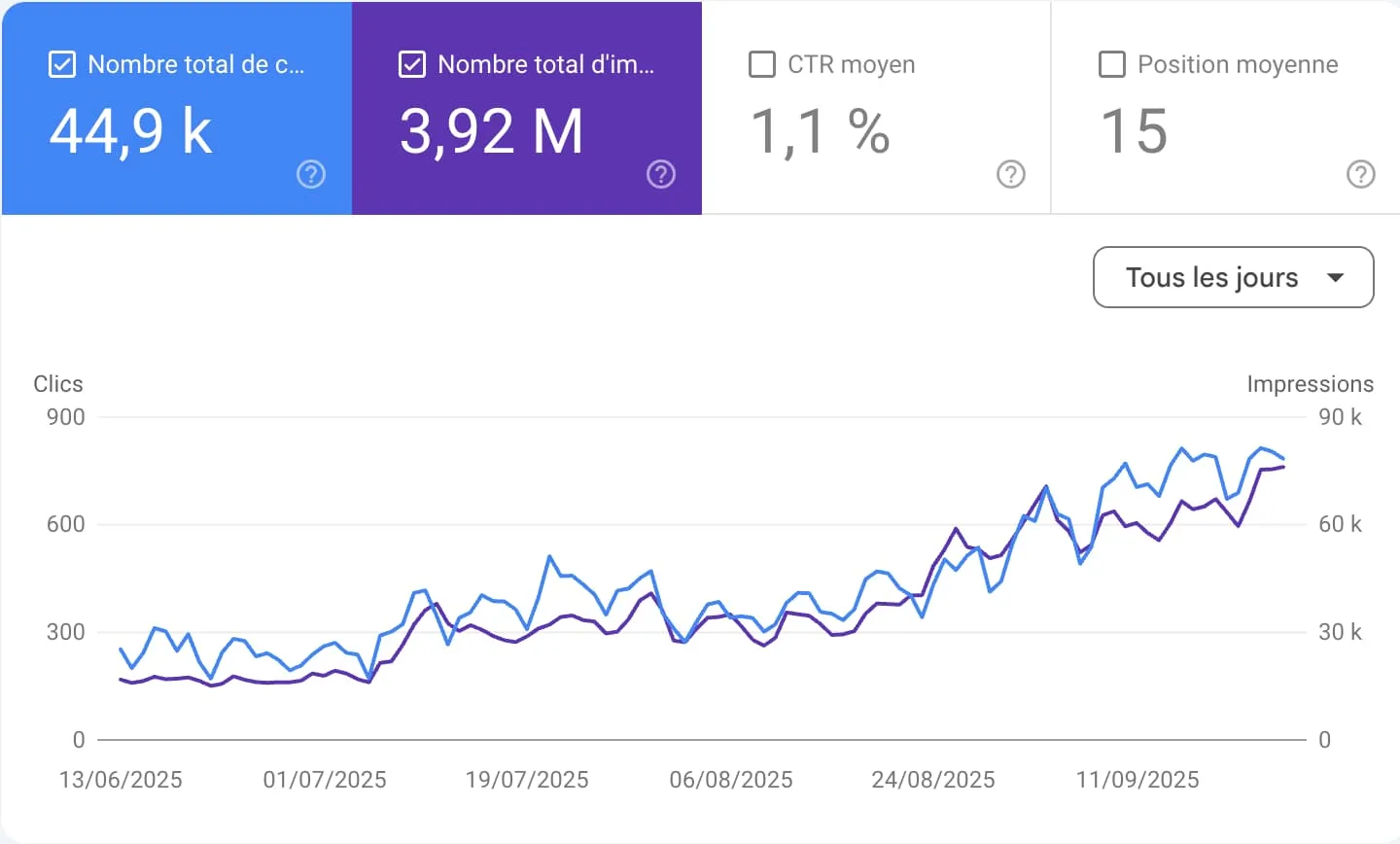

5. Avantages pour votre SEO et votre stratégie de contenu

Même si llms.txt ne s’adresse pas directement aux moteurs de recherche traditionnels, il améliore indirectement le SEO :

- Meilleure visibilité dans les environnements IA. Lorsqu’une personne interroge un outil de type ChatGPT ou une IA connectée, votre contenu a plus de chances d’être correctement identifié et cité.

- Réduction du bruit : vous fournissez un contexte essentiel, ce qui peut réduire les confusions ou la désinformation.

- Amélioration de l’expérience utilisateur : dans les IDE et assistants de code, les suggestions concernant votre bibliothèque/outil seront plus précises, augmentant la satisfaction des utilisateurs et favorisant un bouche-à-oreille positif.

- Autorité de marque : montrez que votre site est « AI-Ready » et utilise des standards modernes (un signal marketing et de confiance).

6. Comment générer et maintenir votre llms.txt ?

6.1 Méthode manuelle

- Listez vos pages prioritaires (guide d’installation, docs API, FAQ produit).

- Ajoutez un résumé concis par lien (

: bref aperçu). - Structurez avec des titres

##, des sections « optionnel », etc.

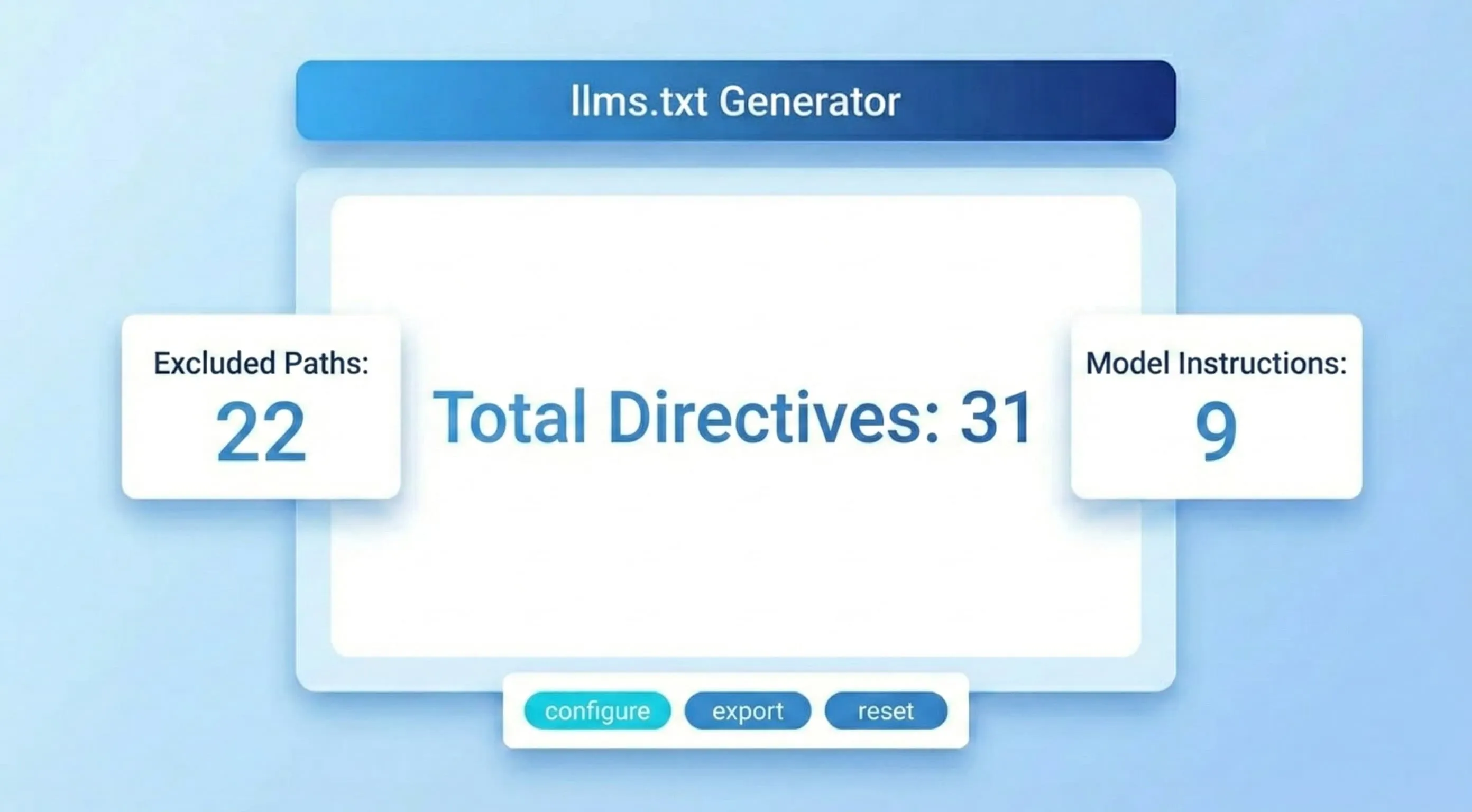

6.2 Outils et plugins

Plusieurs projets open-source et services SaaS proposent de générer votre llms.txt automatiquement :

- llmstxt Generator par Firecrawl ou dotenvx : parcourt votre sitemap, extrait les informations clés et crée un squelette de

llms.txt. - Plugins WordPress (par ex. « Website LLMs.txt ») : scannent vos articles/pages et génèrent un fichier structuré.

- Services comme Mintlify, LangGraph ou llmstxthub.com qui analysent vos docs et produisent un

llms.txt. - Extensions VSCode (

LLMs.txt Explorer) : pour charger ou créer un llms.txt depuis l’éditeur.

6.3 Bonnes pratiques de mise à jour

- Mettez à jour après chaque modification majeure de vos docs ou lors de l’ajout d’une nouvelle section importante.

- Vérifiez régulièrement les liens externes, car un lien cassé dans

llms.txt peut induire les IA en erreur. - Gardez un format minimaliste (inutile d’inclure toute la documentation, juste assez pour guider l’IA vers des ressources plus détaillées).

7. Controverses et limites

- Manipulation de contenu : certains craignent que des acteurs malveillants insèrent des informations trompeuses dans

llms.txt. Si les LLM s’appuient aveuglément sur ce fichier, ils peuvent « halluciner » ou propager de fausses informations. - Adoption : pour que le standard fonctionne, les IDE/agents doivent le respecter. Certains projets IA l’ignorent ; d’autres le supportent déjà.

- Pas un standard W3C officiel : certains experts préconisent de fournir un chemin

/.well-known/llms.txt pour s’aligner sur la RFC 8615, tandis que d’autres préfèrent utiliser directement example.com/llms.txt.

8. Conclusion : faut-il adopter llms.txt pour booster votre SEO IA ?

llms.txt n’est pas obligatoire, mais il gagne en popularité parmi les IDE intelligents, les plugins IA et les communautés open-source. Il simplifie l’intégration de contenu dans les projets IA en temps réel, évite le gaspillage de tokens et favorise une documentation mieux comprise par les modèles de langage.

Ressources supplémentaires

En résumé

Le fichier llms.txt s’impose comme une nouvelle pierre angulaire de la boîte à outils SEO et IA. En fournissant un condensat hiérarchisé de votre contenu clé, il facilite la recherche contextuelle par les agents conversationnels et met en valeur votre documentation technique. Alors que les chatbots et IDE intelligents deviennent la « nouvelle porte d’entrée » vers l’information, adopter llms.txt peut faire la différence.

N’attendez pas pour le mettre en place ! Profitez dès aujourd’hui de la synergie entre votre SEO traditionnel et cette nouvelle couche IA pour offrir la meilleure expérience possible aux utilisateurs… humains et intelligences artificielles.

.svg)

.svg)