Mit dem Aufstieg großer Sprachmodelle (LLMs) und der Verbreitung von KI-Anwendungsfällen entstehen neue Standards, die den Zugang zu Informationen auf Websites erleichtern. Zu diesen Standards gehört die llms.txt-Datei, ein AI-first-Äquivalent, inspiriert von robots.txt und sitemap.xml, aber speziell dafür entwickelt, LLMs (Large Language Models) und deren Tools (z.B. ChatGPT, Claude, Cursor, Windsurf, Replit Ghostwriter usw.) dabei zu helfen, Ihre Inhalte besser zu verstehen und zu nutzen.

In diesem umfassenden Leitfaden erfahren Sie:

- Die Ursprünge von

llms.txt - Die Vorteile für SEO und Informationszugänglichkeit

- Wie Sie es auf Ihrer eigenen Website implementieren

- Best Practices und Fallstricke, die es zu vermeiden gilt

- Konkrete Beispiele

- Vorhandene Ressourcen und Tools, die Ihnen die Arbeit erleichtern

1. Was ist llms.txt und warum sollten Sie es verwenden?

Die llms.txt-Datei ist eine in Markdown verfasste Textdatei (auch wenn sie die Endung .txt behält), die im Stammverzeichnis einer Website platziert wird, ähnlich wie robots.txt. Ihr Zweck ist es, KIs direkt während der Inferenzphase zu leiten (wenn ein Benutzer oder ein Konversationsagent in Echtzeit nach präzisen Informationen sucht), indem sie Folgendes bereitstellt:

- Einen klaren und vereinfachten Überblick über Ihre Website.

- Strukturierte Hinweise, wie der Inhalt verstanden, extrahiert oder genutzt werden soll.

- Potenzielle Links zu kritischen Ressourcen (Dokumentation, API-Seiten, FAQs, technische Anleitungen usw.) in Markdown-Form.

- Optional: Informationen zur Kontextanreicherung (wenn das Kontextfenster eines LLM in der Anzahl der Token begrenzt ist, können Sie einen Block sekundärer Ressourcen definieren, die bei Bedarf ignoriert werden können).

Mit anderen Worten: llms.txt wird zu einem Katalysator, der KIs zum wesentlichen Inhalt leitet und verhindert, dass sie traditionelle HTML-Seiten voller Designelemente, Animationen und Werbung grob oder zu umfangreich parsen.

1.1 Kontext und Bedarf

- LLMs sind oft durch ihr Kontextfenster begrenzt und können eine große Website nicht vollständig laden oder verarbeiten.

- HTML kann komplex zu parsen sein (Navigationsleiste, Dropdown-Menüs, JS-Skripte).

- KIs haben nicht unbedingt die gleiche Crawl-Logik wie Suchmaschinen (GoogleBot, BingBot), und einige IDEs oder Konversationsagenten (Cursor, Claude Code usw.) benötigen eine Plain-Text- oder Markdown-Version der Dokumentation.

Somit rationalisiert llms.txt die Art und Weise, wie KIs einen Überblick über die Website erhalten, und ermöglicht eine bessere Nutzung während der Inferenzphase (z.B. Code-Vorschläge, Expertenantworten, ChatGPT-Plugins usw.).

2. Was ist der Unterschied zwischen llms.txt, robots.txt und sitemap.xml?

robots.txt: Teilt Bots (z.B. GoogleBot, BingBot) mit, wo sie crawlen dürfen und wo nicht. Es liefert keinen Inhalt, nur Zugriffsregeln.sitemap.xml: Listet alle indexierbaren Seiten für Suchmaschinen auf (URL, Datum der letzten Aktualisierung, Prioritäten). Sehr nützlich für SEO, bietet aber keine Inhaltsbeschreibung und erwähnt nicht die „KI-freundliche“ Form der Seiten.llms.txt: Eine Markdown-Datei für KIs, um Seiten zu beschreiben oder auf Seiten zu verweisen, die bei der Inferenz verwendet werden. Sie kann auch strategische Auszüge, grundlegende externe Links und sogar .md-Versionen Ihrer Seiten enthalten. Es ist ein Opt-in-Tool, das Agenten direkt bedient. Es ergänzt, ersetzt aber nicht robots.txt oder sitemap.xml.

3. Empfohlene Struktur und Format

Die llms.txt-Datei soll einfach und flexibel sein. Hier ist die vorgeschlagene Struktur:

3.1 Kernpunkte:

- H1: Der Haupttitel, der Name der Website oder des Projekts, einzigartig und obligatorisch.

- Blockquote: Kurze Beschreibung der Website (wenige Zeilen).

- Dateikörper: Zusätzliche(r) Absatz/Absätze, um die Rolle der Website zu präzisieren oder Hinweise zur Interpretation bestimmter Inhaltselemente zu geben.

- Durch H2 abgegrenzte Abschnitte:

- Links zu relevanten Ressourcen im Markdown-Listenformat auflisten.

- Optional kritische externe Links erwähnen (z.B. wenn Ihre Docs über GitHub, GitLab oder andere Sites verteilt sind).

- Sie können mehrere Abschnitte haben, wie „API“, „Tutorials“, „Beispiele“ usw.

- Abschnitt „Optional“: Signalisiert KIs, dass dieser Abschnitt niedrigere Priorität hat. Wenn der KI der Platz ausgeht, kann sie diesen Inhalt ignorieren.

Hinweis: URLs können auf .md enden, wenn Sie die Text-/Markdown-Version Ihrer Seiten direkt bereitstellen möchten.

4. Konkrete Beispiele

4.1 FastHTML

In der FastHTML-Dokumentation gibt es eine llms.txt (Demo-Datei), die verweist auf:

- Einen Schnellstart

- Eine HTMX-Referenz

- Fortgeschrittene Beispiele

- Optionale Ressourcen zu Starlette

4.2 Anthropic, Perplexity, ElevenLabs, Cloudflare

- Anthropic: bietet eine

llms-full.txt mit der gesamten Dokumentation. Dies erleichtert die Nutzung in IDEs oder Chatbots (z.B. Cursor), die diese Datei direkt laden. - Cloudflare: erwägt, eine dedizierte

llms.txt bereitzustellen, um seine Dienste zu beschreiben. - LangChain, LangGraph: bieten bereits

llms.txt und llms-full.txt an, um das Laden der Dokumentation in einen Konversationsagenten zu ermöglichen.

5. Vorteile für Ihr SEO und Ihre Content-Strategie

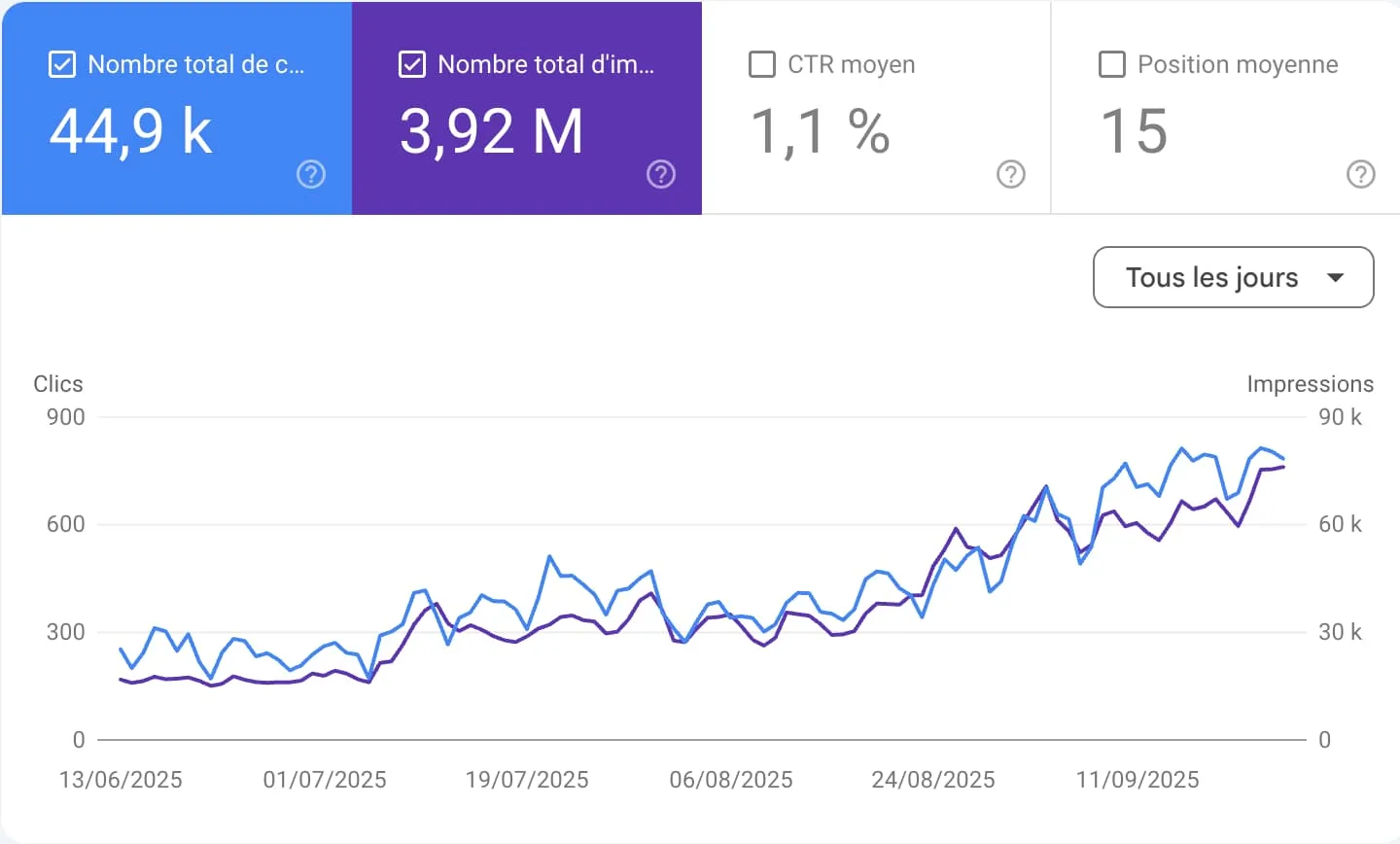

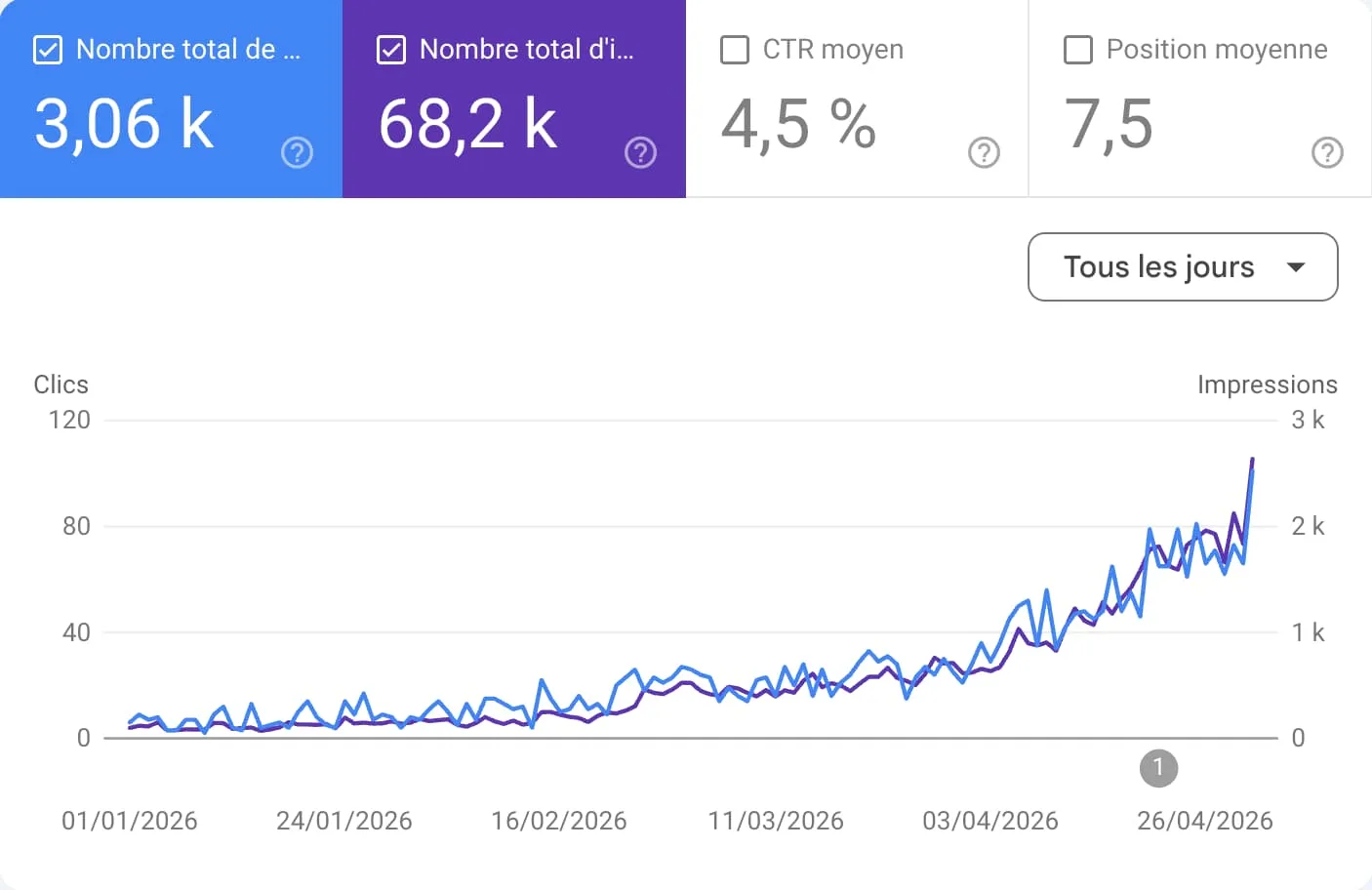

Auch wenn llms.txt nicht direkt auf traditionelle Suchmaschinen abzielt, verbessert es indirekt das SEO:

- Bessere Sichtbarkeit in KI-Umgebungen. Wenn jemand ein ChatGPT-ähnliches Tool oder eine verbundene KI abfragt, wird Ihr Inhalt eher korrekt identifiziert und zitiert.

- Rauschreduzierung: Sie liefern wesentlichen Kontext, was Verwirrung oder Fehlinformationen reduzieren kann.

- Verbesserte Benutzererfahrung: In IDEs und Code-Assistenten werden Vorschläge zu Ihrer Bibliothek/Ihrem Tool präziser, was die Benutzerzufriedenheit steigert und positive Mundpropaganda fördert.

- Markenautoriät: Zeigen Sie, dass Ihre Website „AI-Ready“ ist und moderne Standards nutzt (ein Marketing- und Vertrauenssignal).

6. Wie erstellen und pflegen Sie Ihre llms.txt?

6.1 Manuelle Methode

- Listen Sie Ihre Prioritätsseiten auf (Installationsanleitung, API-Docs, Produkt-FAQ).

- Fügen Sie eine knappe Zusammenfassung pro Link hinzu (

: kurzer Überblick). - Strukturieren Sie mit

##-Überschriften, „Optional“-Abschnitten usw.

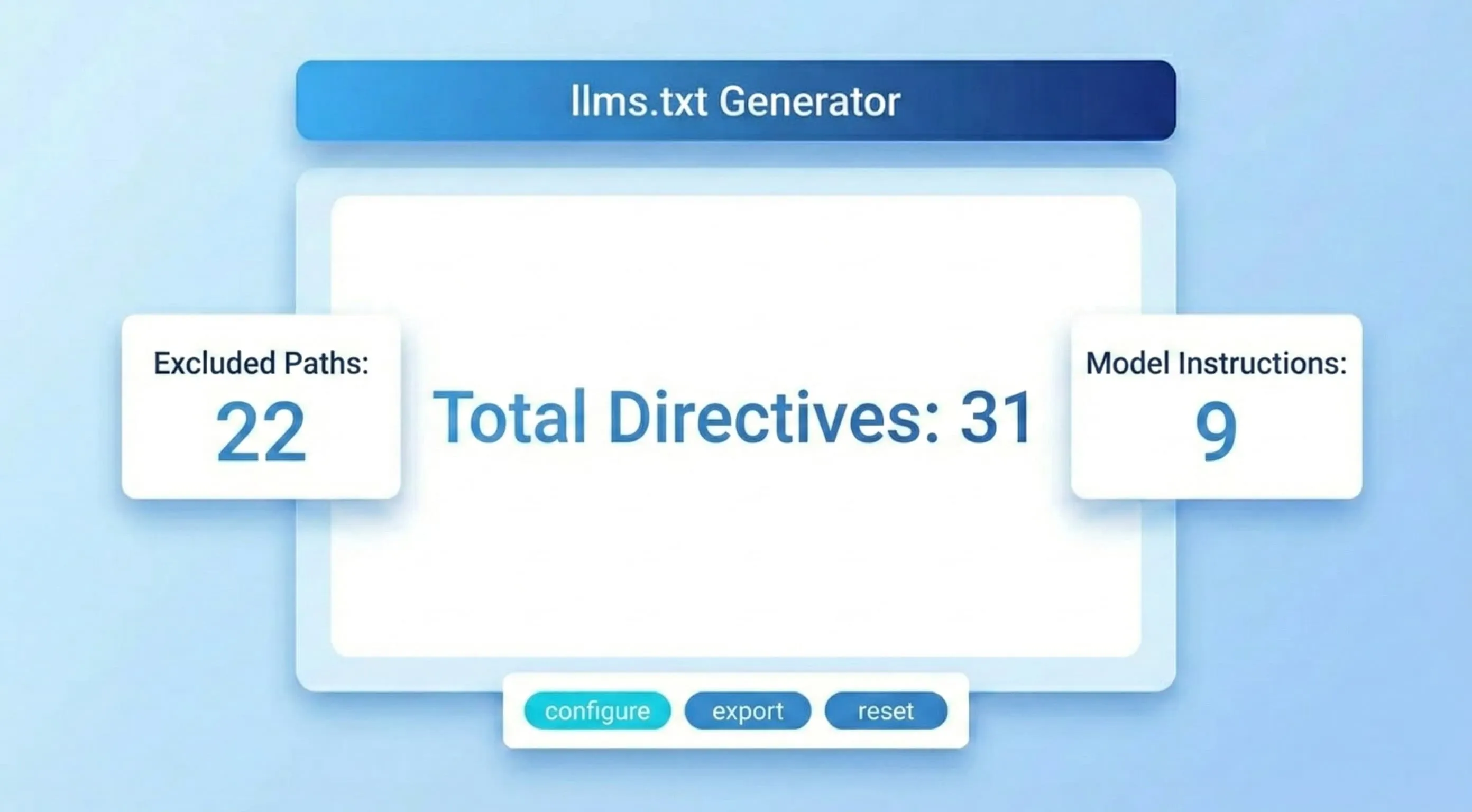

6.2 Tools und Plugins

Mehrere Open-Source-Projekte und SaaS-Dienste bieten an, Ihre llms.txt automatisch zu generieren:

- llmstxt Generator von Firecrawl oder dotenvx: Durchsucht Ihre Sitemap, extrahiert Schlüsselinformationen und erstellt ein

llms.txt-Gerüst. - WordPress-Plugins (z.B. „Website LLMs.txt“): Scannen Ihre Beiträge/Seiten und generieren eine strukturierte Datei.

- Dienste wie Mintlify, LangGraph oder llmstxthub.com, die Ihre Docs analysieren und eine

llms.txt erstellen. - VSCode-Erweiterungen (

LLMs.txt Explorer): Zum Laden oder Erstellen einer llms.txt direkt im Editor.

6.3 Best Practices für Aktualisierungen

- Aktualisieren Sie nach jeder größeren Änderung an Ihren Docs oder beim Hinzufügen eines neuen wichtigen Abschnitts.

- Überprüfen Sie regelmäßig externe Links, da ein defekter Link in

llms.txt KIs in die Irre führen kann. - Halten Sie ein minimalistisches Format bei (es ist nicht nötig, die gesamte Dokumentation einzubeziehen, gerade genug, um die KI zu detaillierteren Ressourcen zu führen).

7. Kontroversen und Einschränkungen

- Inhaltsmanipulation: Einige befürchten, dass böswillige Akteure irreführende Informationen in

llms.txt einfügen könnten. Wenn LLMs sich blind auf die Datei verlassen, können sie „halluzinieren“ oder falsche Informationen verbreiten. - Adoption: Damit der Standard funktioniert, müssen IDEs/Agenten ihn berücksichtigen. Einige KI-Projekte ignorieren ihn; andere unterstützen ihn bereits.

- Kein offizieller W3C-Standard: Einige Experten plädieren für einen

/.well-known/llms.txt-Pfad gemäß RFC 8615, während andere die Verwendung von example.com/llms.txt direkt bevorzugen.

8. Fazit: Sollten Sie llms.txt für Ihr KI-SEO einsetzen?

llms.txt ist nicht obligatorisch, gewinnt aber an Beliebtheit bei intelligenten IDEs, KI-Plugins und Open-Source-Communities. Es vereinfacht die Integration von Inhalten in KI-Projekte in Echtzeit, vermeidet Token-Verschwendung und fördert eine Dokumentation, die von Sprachmodellen besser verstanden wird.

Zusätzliche Ressourcen

Zusammenfassung

Die llms.txt-Datei etabliert sich als neuer Eckpfeiler im SEO- und KI-Werkzeugkasten. Indem sie ein hierarchisch geordnetes Kondensat Ihrer Schlüsselinhalte bereitstellt, erleichtert sie die kontextbezogene Suche durch Konversationsagenten und hebt Ihre technische Dokumentation hervor. Da Chatbots und intelligente IDEs zum „neuen Zugang“ zu Informationen werden, kann die Einführung von llms.txt den Unterschied ausmachen.

Warten Sie nicht mit der Implementierung! Nutzen Sie noch heute die Synergie zwischen Ihrem traditionellen SEO und dieser neuen KI-Ebene, um Nutzern die bestmögliche Erfahrung zu bieten, Menschen und künstlichen Intelligenzen.

.svg)

.svg)