A privacidade é importante para nós, então você tem a opção de desativar certos tipos de armazenamento que podem não ser necessários para o funcionamento básico do site. O bloqueio de categorias pode afetar sua experiência no site. Mais informações

Aprenda a instalar o ficheiro llms.txt no seu site. Um guia para melhorar a classificação do seu site em sistemas IA.

Com a ascensão dos grandes modelos de linguagem (LLMs) e a proliferação de casos de utilização da IA, estão a surgir novos padrões para facilitar o acesso à informação nos websites. Entre estes padrões encontra-se o ficheiro llms.txt, um equivalente orientado para a IA inspirado no robots.txt e no sitemap.xml, mas especificamente concebido para ajudar os LLMs (Large Language Models) e as suas ferramentas (por exemplo, ChatGPT, Claude, Cursor, Windsurf, Replit Ghostwriter, etc.) a compreender e utilizar melhor o seu conteúdo.

Neste mega guia em francês, irá descobrir:

llms.txtllms.txt e por que razão utilizá-lo?O ficheiro llms.txt é um ficheiro de texto escrito em Markdown (embora mantenha a extensão .txt) colocado na raiz de um website, tal como o robots.txt. O seu objetivo é orientar as IAs diretamente durante a fase de inferência (quando um utilizador ou agente conversacional procura informação precisa em tempo real), fornecendo:

Por outras palavras, o llms.txt torna-se um catalisador que direciona as IAs para o conteúdo essencial e impede-as de analisar de forma grosseira, ou demasiado volumosa, as páginas HTML tradicionais repletas de elementos de design, animações e anúncios.

Assim, o llms.txt simplifica a forma como as IAs obtêm uma visão geral do site, permitindo uma melhor utilização durante a fase de inferência (por exemplo, sugestões de código, respostas especializadas, ChatGPT Plugins, etc.).

llms.txt, robots.txt e sitemap.xml?robots.txt: Indica aos bots (por exemplo, GoogleBot, BingBot) onde podem ou não podem rastrear. Não fornece conteúdo, apenas regras de acesso.sitemap.xml: Lista todas as páginas indexáveis para os motores de busca (URL, data da última atualização, prioridades). É muito útil para SEO, mas não fornece uma descrição do conteúdo nem menciona a forma "amigável para IA" das páginas.llms.txt: Um ficheiro Markdown dirigido às IAs para descrever ou apontar para páginas utilizadas na inferência. Também pode incluir excertos estratégicos, ligações externas fundamentais e até versões .md das suas páginas. É uma ferramenta opt-in concebida para servir agentes diretamente. Pode complementar, mas não substituir, o robots.txt ou o sitemap.xml.O ficheiro llms.txt pretende ser simples e flexível. Eis a estrutura proposta:

Nota: Os URLs podem terminar com .md se pretender fornecer a versão texto/Markdown das suas páginas diretamente.

Na documentação do FastHTML, existe um llms.txt (ficheiro de demonstração) que aponta para:

llms-full.txt com toda a sua documentação. Isto facilita a utilização em IDEs ou chatbots (por exemplo, Cursor) que carregam este ficheiro diretamente.llms.txt dedicado para descrever os seus serviços.llms.txt e llms-full.txt para permitir o carregamento da documentação num agente conversacional.Embora o llms.txt não se dirija diretamente aos motores de busca tradicionais, melhora indiretamente o SEO:

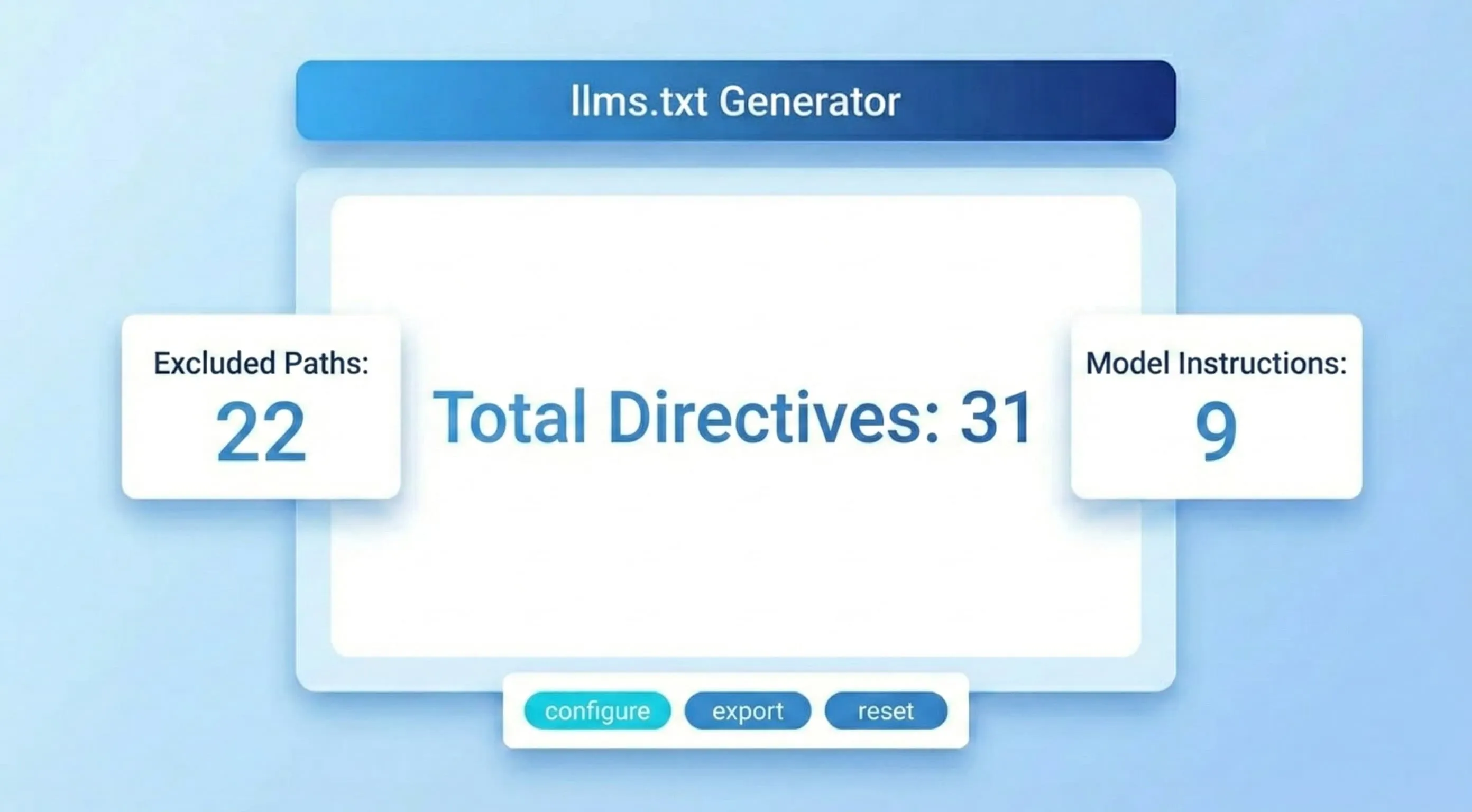

llms.txt?: breve descrição).##, secções "opcionais", etc.Vários projetos open-source e serviços SaaS oferecem a possibilidade de gerar o seu llms.txt automaticamente:

llms.txt.llms.txt.LLMs.txt Explorer): para carregar ou criar llms.txt a partir do editor.llms.txt pode induzir as IAs em erro.llms.txt. Se os LLMs confiarem cegamente no ficheiro, podem "alucinar" ou propagar informação falsa./.well-known/llms.txt para se alinhar com o RFC 8615, enquanto outros preferem utilizar example.com/llms.txt diretamente.llms.txt para impulsionar o seu SEO para IA?O llms.txt não é obrigatório, mas está a ganhar popularidade entre IDEs inteligentes, plugins de IA e comunidades open-source. Simplifica a integração de conteúdo em projetos de IA em tempo real, evita o desperdício de tokens e promove documentação melhor compreendida pelos modelos de linguagem.

O ficheiro llms.txt destaca-se como uma nova pedra angular no conjunto de ferramentas de SEO e IA. Ao fornecer um resumo hierárquico do seu conteúdo-chave, facilita a pesquisa contextual por agentes conversacionais e valoriza a sua documentação técnica. À medida que os chatbots e os IDEs inteligentes se tornam a "nova porta de entrada" para a informação, adotar o llms.txt pode fazer a diferença.

Não espere para o implementar! Aproveite hoje a sinergia entre o seu SEO tradicional e esta nova camada de IA para oferecer a melhor experiência possível aos utilizadores… humanos e inteligências artificiais.

Não, a maioria das IA já consegue fazer «scraping» da web. No entanto, o llms.txt torna o contexto fornecido no momento da inferência mais fluido e fiável. É particularmente útil para suporte ao cliente, autocompletar de código, documentação técnica, etc.

Não, são duas coisas diferentes. O robots.txt serve principalmente para controlar o acesso dos crawlers. O llms.txt destina-se às IA durante a fase de pesquisa de informação (inferência) e oferece um formato conciso, tirando partido das versões Markdown dos seus recursos.

O llms.txt é um padrão opcional. Não criar um equivale a não oferecer esta ponte privilegiada às IA. E se quiser bloquear toda a utilização, deve configurar o seu robots.txt ou implementar medidas técnicas (bloquear user agents, etc.). Mas nada garante que todos os LLM ou scrapers respeitem estas instruções.

Veja como empresas como a sua multiplicaram seu tráfego orgânico em meses com a Sorank.